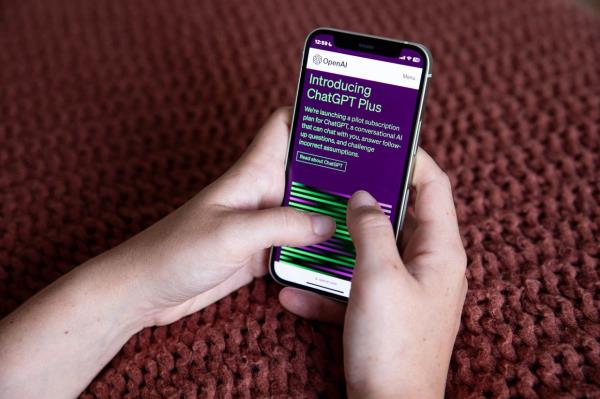

苏珊·谢里登(Susan Sheridan)虽然听说过ChatGPT,但从未尝试过,因此她向这个人工智能聊天机器人提出的第一个问题显得有些混乱:“面部下垂、面部疼痛和牙齿治疗。”

在绝望之际,她向ChatGPT寻求帮助。她的右脸下垂,讲话时感到困难,头痛得无法靠在枕头上。

就在前一天,当她的丈夫首次注意到她的无精打采时,这对夫妻驱车三个小时前往急诊室,医生在确认她的症状为良性后让她回家。

然而,ChatGPT并不认同。聊天机器人告诉她,她的症状可能是贝尔麻痹,需要紧急治疗以防止长期损害。

她再次前往急诊室,医生证实了聊天机器人的判断,并给她开了类固醇和抗病毒药物。最终,她几乎完全康复。

“我并不想取代医生——我相信医患关系和医疗系统,”64岁的谢里丹表示,她是一个病人安全倡导组织的联合创始人。

“但有时系统会失灵。当药物对我们无效时,我们会求助于ChatGPT。”

越来越多像谢里登一样的人开始依赖人工智能聊天机器人来解释新出现的症状,评估治疗方案,审查医生的诊断。

非营利卫生政策研究机构KFF最近的一项调查显示,大约六分之一的成年人——以及约四分之一30岁以下的成年人——每月至少使用一次聊天机器人获取医疗建议和信息。

支持者希望人工智能能为患者提供比简单的谷歌搜索更全面的医学解释,从而增强他们的能力。“谷歌提供信息,而人工智能则为临床思维提供了途径,”患者权益倡导者兼博主戴夫·德布朗卡特(Dave deBronkart)表示。

研究人员对患者如何使用生成式人工智能回答医疗问题的了解仍然有限。关于这一主题的研究主要集中在假设的医疗案例上。

布朗大学公共卫生研究员、教授Ateev Mehrotra博士研究人工智能聊天机器人的患者使用情况,他认为专家们尚未掌握有多少人正在使用这项技术来解答健康问题。

他说:“我们一直认为这是未来的事情,但现在还没有大量使用。”在KFF的调查中,“我对如此高的比例感到震惊”。

耶鲁大学医学院的生物伦理学家和神经学家本杰明·托尔钦博士表示,自从ChatGPT于2022年向公众开放以来,每个月都有少数患者告诉他,他们使用聊天机器人来研究自己的病情。

在很大程度上,他认为该工具有助于告知患者他们的病情和可用的治疗方案,但他也看到了聊天机器人的缺点。

问题不仅在于人工智能可能提供错误或不完整的医疗信息——许多谷歌员工也面临这个问题。托尔钦指出,聊天机器人在回答问题时表现出一种权威的态度,这可能会让患者对其建议产生错误的信心。

他说:“对患者来说,这比他们在谷歌上搜索到的零星信息更具说服力,也更完整。”

例如,他的一位患者曾使用聊天机器人寻找治疗药物失效的癫痫发作的方案。在建议的治疗方法中,干细胞移植是一个患者尚未考虑的选项。

托尔钦不得不向一个充满希望的家庭解释,干细胞移植完全是一种实验性治疗,而不是任何神经科医生都会推荐的选择,这是聊天机器人没有提到的区别。

“他们的印象是,他们对所有不同的治疗方案都有相当完整的了解,”他说。“但我认为,这可能会导致误解。”

在KFF的研究中,只有不到10%的受访者表示,他们“非常有信心”能够区分人工智能聊天机器人产生的真假信息。

DeBronkart表示,像任何工具一样,使用ChatGPT获取健康信息也有其正确的方法。他指出,这些问题需要精心构思,答案需要以怀疑的态度来审视。

“这些都是帮助你提升思维的有力工具,”他说。“我们不希望人们认为这能立即给出答案,这样他们就不用再思考了。”——《纽约时报

本文来自作者[admin]投稿,不代表llgla号立场,如若转载,请注明出处:https://llgla.cn/zheh/202507-1275.html

评论列表(4条)

我是llgla号的签约作者“admin”!

希望本篇文章《聊天机器人如今能够识别你》能对你有所帮助!

本站[llgla号]内容主要涵盖:国足,欧洲杯,世界杯,篮球,欧冠,亚冠,英超,足球,综合体育

本文概览: 苏珊·谢里登(Susan Sheridan)虽然听说过ChatGPT,但从未尝试过,因此她向这个人工智能聊天机器人提出的第一个问题显得有些混乱:“面部...